Gestión de atributos y modelos: cómo hacer seguimiento de la estabilidad sin debilitar tu estrategia de decisión

Publicado el: 2026-04-11 14:32:45

En crédito, fraude, seguros, y onboarding, los equipos suelen asumir que más datos conducen a mejores modelos. A veces ocurre. Muchas veces no. Un predictor puede parecer útil en desarrollo y después fallar en producción porque su distribución cambia, una categoría es demasiado pequeña, o la fuente de datos se comporta de forma distinta según segmentos, canales, o periodos de tiempo.

Aquí importan la gestión de atributos y la gestión de modelos. Los modelos estables dependen de atributos estables. Si no supervisas cómo se definen, agrupan, y usan los predictores dentro de la lógica de decisión, puedes introducir volatilidad en las decisiones de producción sin detectarlo a tiempo.

El problema no se limita a data science. La inestabilidad de los atributos se traslada aguas abajo a las reglas de política, los umbrales de score, las colas de revisión manual, los precios, los controles de fraude, y los informes de cumplimiento. Un predictor débil rara vez permanece aislado. Afecta a todo el flujo de decisión.

Para los equipos que construyen lógica de decisión determinista y auditable, esto significa que la estabilidad no es un extra opcional. Es un requisito operativo.

Por qué añadir más atributos puede empeorar un modelo

Es tentador incluir todas las señales disponibles en un modelo. Nuevos datos de proveedores, características de comportamiento, verificaciones de identidad, inteligencia de dispositivo, patrones de transacciones, y variables derivadas pueden parecer predictivos durante el desarrollo. Pero el poder predictivo en una muestra de entrenamiento no es lo mismo que el valor operativo en producción.

Un atributo puede perjudicar la calidad del modelo por varias razones:

- Tiene una representación débil. Algunos valores o categorías aparecen con demasiada poca frecuencia como para sostener una estimación estable.

- Es sensible a cambios en la mezcla de captación. Un cambio de canal puede alterar rápidamente la distribución del predictor.

- Depende de la calidad de datos externos. Las entradas de terceros pueden desviarse, fallar, o cambiar de significado.

- Introduce volatilidad a nivel de segmento. Una variable puede rendir bien en general, pero fallar en subpoblaciones clave.

- Es difícil de explicar y gobernar. Eso genera fricción para la auditabilidad, la validación, y la gestión de umbrales.

En la práctica, un modelo con menos predictores bien gestionados suele rendir mejor con el tiempo que un modelo lleno de variables inestables. Esta es una de las razones por las que las scorecards y los predictores agrupados siguen siendo habituales en entornos regulados. Renuncian a una pequeña parte del incremento a corto plazo a cambio de mejor control, supervisión más sencilla, y una lógica de decisión más estable.

Qué significa realmente la gestión de atributos

La gestión de atributos es la disciplina de definir, documentar, probar, supervisar, y gobernar los predictores utilizados en modelos y flujos de decisión. Abarca mucho más que una lista de features en un notebook.

Una buena gestión de atributos debería responder cinco preguntas:

- Definición: ¿Qué mide exactamente el atributo?

- Origen: ¿De dónde procede el valor y cómo se calcula?

- Transformación: ¿Es un dato bruto, binado, limitado, normalizado, o combinado con otros campos?

- Cobertura: ¿Con qué frecuencia está presente y para qué poblaciones?

- Estabilidad: ¿Su comportamiento predictivo sigue siendo consistente con el tiempo?

Sin esta estructura, los equipos terminan con dependencias ocultas. Un predictor se reutiliza en scorecards, controles de fraude, y lógica de precios, pero nadie se da cuenta de cuándo cambia su distribución. Cuando el problema aparece en las tasas de aprobación o en el rendimiento de pérdidas, la causa raíz ya está enterrada en varios flujos de decisión.

Si tu lógica de decisión combina reglas, scorecards, y modelos, la necesidad de trazabilidad es aún mayor. Para una visión práctica de cómo mantener la lógica explicable en producción, consulta Implementación de scorecards en rule engines.

Por qué el binning y la categorización de predictores mejoran la estabilidad

El binning suele considerarse anticuado frente a las variables continuas brutas y la ingeniería automática de features. Esa visión pasa por alto un punto importante. El binning no es solo una comodidad de modelado. Es un mecanismo de control.

Cuando binas o categorizas un predictor, reduces la sensibilidad al ruido y haces que la relación entre el predictor y el resultado sea más fácil de observar, validar, y supervisar. En lugar de reaccionar a cada pequeña fluctuación en un valor bruto, el modelo evalúa un conjunto controlado de rangos o grupos.

Esto ayuda de varias maneras:

- Suaviza el ruido. Pequeños cambios numéricos no desencadenan respuestas inestables del modelo.

- Mejora la interpretabilidad. Los equipos pueden inspeccionar cómo se comporta cada bin y explicar su impacto.

- Favorece relaciones monotónicas. Esto es útil cuando el riesgo debe moverse en una dirección coherente.

- Reduce el overfitting. Es menos probable que el modelo se aferre a patrones locales que no persisten.

- Facilita la supervisión. Los cambios de población y rendimiento a nivel de bin son más fáciles de seguir que miles de valores brutos.

Por ejemplo, la edad como variable bruta puede mostrar irregularidades locales causadas por la composición de la muestra. Agrupar la edad en bandas significativas puede producir una señal más estable. Lo mismo aplica a ingresos, antigüedad, número de transacciones, o medidas de tiempo transcurrido desde un evento. En contextos de fraude, los patrones dispersos de dispositivos o de correo electrónico también pueden requerir agrupación antes de ser seguros para usar en la lógica de decisión en producción.

Si trabajas con scorecards o variables agrupadas dentro de un entorno basado en reglas, Implementación de scorecards en rule engines ofrece una base relacionada.

El riesgo de categorías débiles y bins delgados

El binning ayuda a la estabilidad, pero solo cuando los bins en sí son estadística y operativamente sólidos. Una categoría con muy poco volumen puede crear una falsa sensación de poder predictivo. En desarrollo, puede parecer que separa con claridad los resultados buenos y malos. En producción, esa misma categoría puede oscilar de forma brusca porque nunca tuvo suficiente poder representativo desde el inicio.

Este es uno de los problemas de estabilidad más comunes en la gestión de modelos. Los bins delgados generan estimaciones inestables. Las estimaciones inestables generan scores inestables. Y los scores inestables afectan a los puntos de corte, la lógica de enrutamiento, y las decisiones posteriores.

Las señales de alerta típicas incluyen:

- Recuentos de muestra muy pequeños en uno o varios bins.

- Grandes oscilaciones de rendimiento entre desarrollo, validación, y ventanas recientes de producción.

- Orden de ranking poco intuitivo que cambia entre periodos de tiempo.

- Movimientos bruscos en las distribuciones de bins tras cambios de canal, política, o proveedor.

- Buen rendimiento agregado pero comportamiento débil o contradictorio en segmentos clave.

Cuando una categoría no tiene suficiente poder representativo, no debería permanecer automáticamente en el modelo solo porque mejora una métrica de desarrollo. A veces la respuesta correcta es fusionar categorías, volver a binar el predictor, limitar valores extremos, o eliminar el atributo por completo.

Esa decisión no va contra data science. Es una buena gobernanza del modelo.

La estabilidad del modelo es un tema de estrategia de decisión, no solo de modelo

Muchos equipos tratan la supervisión de modelos como una disciplina separada de la gestión de políticas. En producción, esa separación rara vez se sostiene.

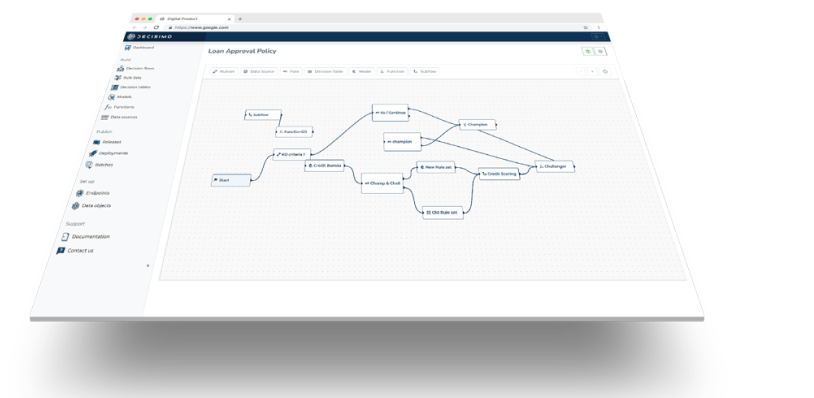

Un score de modelo suele ser solo una parte de un flujo de decisión más amplio. Alimenta políticas de aprobación, precios basados en riesgo, escalado de fraude, activadores de revisión manual, controles de exposición, y reglas de tratamiento al cliente. Si el modelo se vuelve inestable, la estrategia de decisión más amplia también se vuelve inestable.

Por eso la gestión de modelos debería estar muy cerca de la gestión de la lógica de decisión. Los equipos necesitan seguir no solo si un modelo rinde bien, sino si sigue comportándose como se espera dentro de la política operativa.

Para los equipos de lending, esto se vuelve especialmente importante a medida que aumenta la escala y se multiplican las capas de política. Consulta Proceso de aprobación de crédito para una visión relacionada sobre cómo mantener los cambios bajo control.

Qué supervisar al hacer seguimiento de la estabilidad de atributos y modelos

La supervisión de la estabilidad debería realizarse tanto a nivel de atributo como a nivel de modelo. Supervisar solo las métricas globales del modelo llega demasiado tarde. Para entonces, el drift puede estar afectando ya a los resultados de producción.

Supervisión a nivel de atributo

- Distribución de población por bin o categoría a lo largo de ventanas temporales

- Tasa de faltantes y uso de valores por defecto o de respaldo

- Cobertura por canal, producto, geografía o segmento de cliente

- Tasa de resultado dentro de cada bin para comprobar el orden de ranking y la consistencia

- Actualidad de la fuente de datos y tasas de fallo para atributos externos

Supervisión a nivel de modelo

- Drift de la distribución de scores

- Movimiento de la tasa de aprobación o denegación

- Population Stability Index o medidas equivalentes de drift

- Tasa de impago o tasa de fraude por banda de score

- Cambios de calibración entre resultados previstos y observados

- Rendimiento a nivel de segmento, no solo promedios de cartera

La clave es conectar estas vistas. Si aparece drift en los scores, deberías poder rastrear qué atributos se movieron, qué bins cambiaron, y qué umbrales de decisión quedan ahora expuestos. Esa trazabilidad acelera la remediación y simplifica las auditorías.

Para los equipos que afinan controles de underwriting, Métricas para monitorear en préstamos y evaluación crediticia es un complemento útil.

Reglas prácticas para un diseño estable de predictores

No existe una plantilla única para cada cartera, pero varias reglas se aplican en la mayoría de los casos.

- Prioriza predictores con un significado de negocio claro. Si nadie puede explicar por qué una variable debería predecir el riesgo, es más difícil gobernarla y defenderla.

- Agrupa las variables continuas con criterio. Los bins deben reflejar suficiente volumen, un comportamiento estable, y un orden lógico.

- Evita categorías con representación débil. Fusiónalas cuando sea posible o elimínalas.

- Prueba la estabilidad a lo largo del tiempo y de los segmentos. Un predictor que solo funciona en una campaña o un trimestre es frágil.

- Documenta cada transformación. El campo bruto, el campo derivado, la lógica de binning, y el tratamiento de respaldo deben ser trazables.

- Supervisa las dependencias externas. Si un proveedor cambia la calidad del payload o los patrones de respuesta, tu modelo puede desviarse antes de que las métricas principales lo reflejen.

- Coordina los cambios de modelo con los cambios de política. Actualizar umbrales sin revisar atributos puede producir efectos no deseados en la cartera.

Este enfoque encaja bien con flujos de decisión deterministas, en los que la lógica necesita seguir siendo observable y versionada. Aunque uses machine learning, la lógica de decisión que la rodea debería dejar claro cómo se evalúan y se actúa sobre las salidas del modelo.

Cuándo eliminar un atributo de un modelo

Los equipos suelen mostrarse reacios a eliminar atributos una vez que han sido diseñados, probados, y aprobados. Pero un predictor debe ganarse su lugar de forma continua, no solo una vez.

Considera eliminar o rediseñar un atributo cuando:

- Su distribución se desvía repetidamente sin una explicación de negocio estable.

- Sus bins muestran poco volumen o tasas de eventos inestables.

- Su contribución es pequeña, pero su sobrecarga de gobernanza es alta.

- Depende de una fuente externa con disponibilidad o calidad inconsistentes.

- Genera problemas de explicabilidad en decisiones reguladas.

- Añade complejidad a la lógica de decisión con poco beneficio operativo.

En muchos casos, un conjunto de atributos más simple conduce a un mejor rendimiento a largo plazo. El objetivo no es maximizar el número de predictores. El objetivo es construir una lógica de decisión que siga funcionando en condiciones operativas reales.

Construye para el control, no solo para el lift

Una buena gestión de modelos no consiste en perseguir la mejor puntuación de desarrollo. Consiste en mantener las decisiones de producción estables, explicables, y alineadas con la política del negocio.

Eso empieza con la gestión de atributos. Si introduces atributos con poca representación en un modelo, la inestabilidad no se quedará dentro del modelo. Se propagará a tu estrategia de decisión. El binning y la categorización de predictores ayudan a reducir ese riesgo porque obligan a estructurar, mejoran la interpretabilidad, y hacen que el drift sea más fácil de detectar antes de que resulte costoso.

Para los equipos que ejecutan decisiones automatizadas a escala, este es el estándar práctico: utilizar atributos que puedas definir, rastrear, supervisar, y defender. Agrupa los predictores de forma que conserven su poder representativo. Elimina las características que añaden ruido. Después, conecta la supervisión del modelo con el flujo de decisión más amplio, para que los problemas de rendimiento no se conviertan en fallos de política.

Así es como los modelos estables respaldan decisiones empresariales estables.